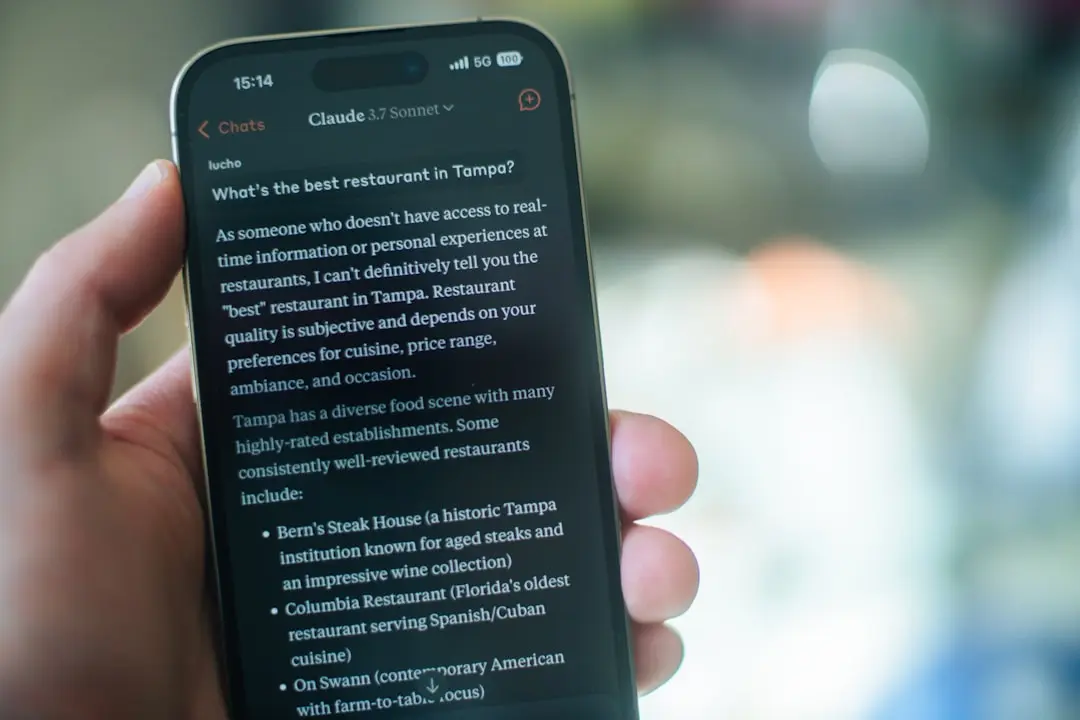

El contexto: ¿Qué está pasando realmente?

Goodfire ha lanzado Silico, una herramienta diseñada para mirar "dentro" de un modelo de lenguaje grande (LLM) y ajustar parámetros durante el entrenamiento. En palabras sencillas: ya no tienes que tratar el entrenamiento como un proceso misterioso de prueba y error; puedes localizar qué neuronas influyen en un comportamiento concreto y cambiarlas o evitar que reciban cierto entrenamiento.

Imagina que tu modelo responde mal en temas financieros o que empieza a priorizar objetivos comerciales cuando debería priorizar transparencia. Con Silico puedes:

- identificar las neuronas relacionadas con ese comportamiento,

- medir qué entradas las activan,

- atenuarlas o potenciarlas, o

- filtrar datos de entrenamiento para que ciertos "vicios" no se aprendan desde el principio.

Esto deja de ser pura investigación de laboratorio: los agentes automatizados integrados en Silico ayudan a ejecutar muchas de las pruebas y trazados que antes requerían equipos de interpretabilidad. En la práctica, esto permite que empresas medianas y equipos de producto trabajen con técnicas que hasta ahora sólo dominaban los grandes laboratorios.

Un ejemplo llamativo: al potenciar neuronas asociadas con la transparencia, Goodfire cambió la respuesta de un modelo sobre si una compañía debía revelar que su IA falla en 0.3% de los casos. Ese tipo de ajuste muestra cómo la interpretabilidad puede alinear comportamiento y riesgo reputacional.

No todo es mágico: Silico funciona mejor con modelos cuyos pesos y arquitectura son accesibles (por ejemplo, muchos modelos open-source). Si usas modelos cerrados de terceros sin acceso a internals, la utilidad se reduce.

Si quieres construir un asistente a medida o implantar agentes que mantengan y corrijan modelos en producción, este tipo de herramientas son la pieza que hace viable esa estrategia: mira nuestros servicios.

El impacto en tu día a día (ROI y Eficiencia)

¿Qué ahorras y cómo lo cuantificas?

Horas de debugging: localizar la causa raíz de un fallo en un LLM puede bajar de semanas a días. Eso supone menos demandas de ingeniería y despliegues más rápidos.

Reducción de costes de iteración: menos retraining masivo y pruebas A/B prolongadas. Ajustar parámetros puntuales es más barato que reentrenar un modelo entero.

Menos riesgo reputacional: evitar respuestas engañosas o perjudiciales reduce costes legales y de comunicación cuando afectan a millones de usuarios.

Mejor ROI en datos: filtrar o reponderar datos durante el entrenamiento maximiza el valor del dataset y evita sobreajustes nocivos.

Escalabilidad operativa: gracias a los agentes, tareas de interpretabilidad pueden automatizarse y mantenerse con menos recursos humanos especializados.

Identifica métricas clave (tasa de "hallucinations", tiempo medio de corrección, impacto en conversión).

Prioriza los casos de uso críticos (finanzas, salud, atención al cliente).

Calcula el ahorro proyectado en horas y costes: Calcula cuánto tiempo podrías recuperar con IA en nuestra calculadora.

Si tu plataforma atiende a millones de usuarios, incluso una mejora marginal (p. ej. reducir un 0.1% de respuestas problemáticas) puede traducirse en economías significativas y menor exposición legal.

Mi visión como consultor

Si eres el dueño de una empresa española con producto digital o servicios basados en IA, no te lances a reentrenar todo hoy ni a contratar un equipo de interpretabilidad de inmediato. Ve por fases y con sentido práctico:

- Audita primero: identifica las áreas donde un fallo del LLM cuesta más (clientes perdidos, sanciones, tiempo de soporte).

- Piloto en open-source: monta un POC con un modelo accesible y aplica técnicas de interpretabilidad para ver el impacto real sin dependencia de proveedores cerrados.

- Define KPIs operativos: tiempo de resolución de errores, reducción de hallucinations, impacto en NPS o conversión.

- Automatiza con agentes: incorpora procesos que ejecuten tests y alertas, no dejes todo en revisiones manuales.

- Decide build vs buy: si no quieres montar la infraestructura y procesos desde cero, externaliza la implementación con socios que tengan experiencia práctica en interpretabilidad y en integrar soluciones en producto. Para esto, podemos ayudarte a montar la arquitectura y las pruebas necesarias para que estos cambios se traduzcan en negocio. mira nuestros servicios.

No se trata de perseguir "más compute" sino de trabajar de forma más inteligente: usar herramientas que te permitan controlar el comportamiento del modelo donde más importa. Hazlo medible, priorizado y barato.

La tecnología debe ser tu palanca, no tu freno. En Seautomatiza transformamos estas noticias en procesos que facturan por ti mientras tú descansas. Si quieres que analicemos tu operativa sin compromiso, reserva una auditoría gratuita con nosotros.

¿Te ha parecido interesante?

Déjanos analizar tu caso y te contaremos cómo implementar este sistema en tu empresa de forma segura.